@3/6/2026

0. 선수지식 (Prerequisites)

•

가우시안 분포(Gaussian Distribution) 또는 정규분포(Normal Distribution): 평균()과 표준편차()에 의해 결정되는 종 모양의 분포

•

최대 우도 추정(Maximum Likelihood Estimation, MLE): 주어진 데이터가 나타날 확률(우도)을 최대화하는 분포의 모수(평균, 분산 등)을 역으로 추정하는 수학적 기법

•

로그 함수와 미분(Logarithms & Derivatives): 덧셈과 곱셈을 변환하는 로그의 성질과 체인 룰(chain rule)을 활용한 미분

•

베이즈 정리(Bayes’ Theorem): 사전 확률(prior), 우도(likelihood), 정규화 상수(evidence)를 이용해 사후 확률을 계산하는 원리

1. 가우시안 혼합 모델이 왜 필요할까?

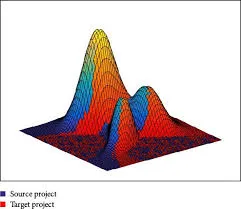

현실의 데이터는 여러 그룹이 섞여 있는 경우가 빈번하다(예: 레이블이 없는 군집화 문제). 각 그룹의 데이터가 별개의 분포로부터 나온다고 할 때, 단일 가우시안 분포로는 다봉형(multimodal) 데이터의 복잡성을 근사(approximate)할 수 없다.

2. 가우시안 혼합 모델 정의

가우시안 혼합 모델(Gaussian Mixture Model, GMM)은 여러 개의 정규 분포(가우시안 분포)를 혼합하여 복잡한 확률 분포를 근사하기 위한 머신러닝 알고리즘이다. 초매개변수 는 혼합되는 가우시안 분포의 수를 나타낸다.

일반적인 정규 분포(좌)와 인 GMM 예시(우) (출처: CHML)

GMM에서 주어진 데이터 가 발생할 확률은 다음 식과 같이 개의 가우시안 확률밀도함수(probability density function)의 혼합으로 정의된다.

•

: 전체 데이터 집합에서 특정 데이터 가 관측될 확률

•

: 혼합할 가우시안 분포의 개수 (데이터를 몇 개의 그룹을 나눌 것인지 결정)

•

(혼합 계수, mixing coefficient): 번째 가우시안 분포가 전체에서 차지하는 비중 또는 가중치

•

: 번째 가우시안 분포

◦

(평균): 번째 분포의 중심점

◦

(공분산): 번째 분포의 퍼짐 정도와 방향

GMM은 간단히 말해 “복잡한 데이터의 분포를 여러 개의 정규분포를 합쳐서 설명하겠다”는 아이디어입니다. 하나의 정규분포로는 표현하기 힘든 복잡한 모양의 데이터를, 여러 개의 작은 정규분포 덩어리들로 나누어 맞추는 것이죠.

혼합 계수의 제약 조건

이 조건은 혼합 계수 가 확률의 성질을 가져야 함을 의미한다.

•

: 모든 가우시안 분포의 혼합 계수 총합은 반드시 1(100%)이다.

GMM 학습의 목표

GMM을 학습시킨다는 것은, 주어진 데이터들()을 가장 잘 설명할 수 있는 최적의 파라미터 조합()을 찾아내는 과정이다.

•

찾아야 할 것(): 각 분포 비중(), 평균(), 그리고 공분산()

•

방법: 데이터가 발생할 확률 ()을 최대로 만드는 값을 찾으며 보통 EM(Expectation-Maximization) 알고리즘을 이용함

◦

E-step: 현재의 를 이용해 각 데이터 가 어떤 분포에 속하는지(책임도, )를 계산 → “데이터가 이 분포에 속할 것이다.”

◦

M-step: 계산된 책임도 를 바탕으로 매개변수()를 업데이트

GMM에서 EM 알고리즘이 왜 사용되는지를 이해하려면 최대 우도 추정(MLE) 방법과 이 방법을 그대로 GMM에 바로 적용할 수 없는 이유를 이해해야 됩니다.

3. 최대 우도 추정과 잠재변수

레이블이 없는 데이터는 데이터만 주어지고 이 데이터가 어떤 분포에서 왔는지 레이블(정답)이 주어지지 않은 경우를 말한다. 일반적으로 최대 우도 추정(MLE) 방법을 사용해 데이터에 가장 잘 맞는 가우시안 분포()를 추정할 수 있다.

최대 우도 추정 (Maximum Likelihood Estimation, MLE)

매개변수 추정 문제는 관측된 데이터 가 주어졌을 때, 이 데이터를 가장 잘 설명하는 정규 분포의 최적 매개변수를 찾는 문제이다.

MLE 문제 예: 빨간색 분포와 파란색 분포 중에 데이터에 더 적합한 분포는 무엇인가? (출처: 공돌이의 수학정리노트)

•

(평균): 분포의 중심 위치를 결정

•

(공분산): 분포의 흩어진 정도와 방향을 결정

◦

[1차원 데이터 경우] (표준편차): 분포의 너비와 높이를 결정

MLE의 중요 개념인 우도(likelihood)는 어떤 분포의 매개변수 가 주어졌을 때, 데이터 가 나타날 확률()이며, 본 글에서는 심플하게 로 표기한다.

베이즈 정리에서 우도는 더 추상적인 형태로 정의되며, 조건 A가 주어졌을 때 데이터 B가 나타날 확률로서 로 표기합니다.

전체 우도를 나타내는 우도 함수(likelihood function, )는 개별 우도의 곱으로 계산되며, MLE의 목표는 우도 함수 이 최대가 되는 를 찾는 것이다.

최대 우도 추정 결과 예시: 부적합(좌), 적합(우)

우도 함수의 계산은 와 같이 많은 곱셈 연산으로 이루어졌는데, 여기에 로그 변환을 적용하게 되면 로그 우도(Log-Likelihood)가 되며, 로그의 곱셈을 덧셈으로 변환하는 성질()을 이용하여 단순한 덧셈식으로 표현할 수 있다.

수식이 단순해진 것이 중요한 것이 아니라, 로그 우도 함수의 미분값이 0이 되는 지점을 풀면 최적의 매개변수를 쉽게 찾을 수 있으므로, 계산이 훨씬 간편해지는 장점이 있다. 따라서, 일반적으로 MLE에서는 로그 우도 함수로 변환한 뒤에 매개변수 추정을 수행한다.

MLE을 쉬워지게 도와주는 로그 변환

GMM에서의 MLE 적용 → 닫힌 형태 해의 부재

GMM의 경우 MLE를 바로 적용할 때 로그 함수 내부에서 가우시안 분포의 합(sum)이 존재하기 때문에 닫힌 형태(closed-form)의 방정식으로 정리되지 않는 문제점이 존재한다.

닫힌 형태 해(closed-form solution)란, 유한한 횟수의 수학적 연산으로 정확한 정답을 구할 수 있는 해를 의미합니다.

결국, 수식이 형태가 되며, 로그 함수 내부에 덧셈이 있으면 쪼갤 수가 없어서 미분을 통한 최적의 해를 구하는 것이 불가능하다.

GMM에 MLE를 적용하는 경우의 문제점: 닫힌 형태 해의 부재

잠재변수의 도입과 트릭

잠재변수(latent variable)는 직접 관측되지는 않지만, 다른 관측 가능한 변수들을 통해 간접적으로 추론할 수 있는 변수를 말하며, 보통 복잡한 수학적 최적화 문제를 쉽게 풀기 위해 모델에 가상으로 도입하는 숨겨진 변수이다. GMM에서 잠재변수는 ‘데이터 가 몇 번째 가우시안 분포(그룹)에서 생성되었는지’를 나타내는 정답(레이블)으로 정의할 수 있다.

위에서 설명한 것 처럼, GMM은 여러 가우시안 분포의 합으로 표현되기 때문에 기본적으로 MLE을 적용할 수 없다. 이때 잠재변수 를 수식에 도입하면, 직접 계산하기 어려운 원래의 목적함수 대신 목적함수의 하한(lower bound)을 간접적으로 최대화하는 풀기 쉬운 문제로 바꿀 수 있다.

잠재 변수와 로그-우도 함수의 하한선 최대화

수학에서 최적화가 어려운 문제의 경우 대신 함수의 하한선을 최대화하는 방식의 트릭을 활용하는 경우가 있으며, 여기에 Jensen의 부등식(Jensen’s Inequality)를 활용합니다.

4. EM 알고리즘

위에서 도입한 잠재변수(데이터가 어떤 가우시안 분포에서 생성되었는지)의 값을 알고 있다면, MLE을 통해 각 분포의 매개변수를 쉽게 계산할 수 있다. 하지만 문제는 GMM에서 가정하는 데이터는 레이블을 모르는 데이터이기 때문에 여전히 MLE을 적용할 수 없는 상태이다.

따라서 GMM은 잠재변수를 기반으로 기댓값 최대화 알고리즘(Expectation-Maximization, EM)을 사용해 우회적으로 이 문제를 해결한다.

GMM에서 EM 알고리즘은 현재의 분포 매개변수를 바탕으로 데이터의 레이블을 예측하고(E-Step), 예측된 레이블을 바탕으로 기존 분포의 매개변수를 역으로 업데이트(M-Step)하는 과정을 반복하여 모델을 학습시킨다.

EM 알고리즘의 수행 흐름

E-Step: 잠재변수(레이블)의 확률 계산

E-Step(Expectation Step)의 핵심 목적은 현재의 분포 매개변수를 기준으로, 각 데이터가 개의 가우시안 분포 중 어느 그룹에 속할지 그 확률을 추정하는 것이다. 이를 책임도 로 표기하며, 잠재변수의 확률분포를 나타낸다.

특정 데이터 이 번째 그룹에 속할 확률인 책임도 는 사후 확률(Posterior)을 구하기 위한 베이즈 정리를 통해 계산된다.

•

사전 확률(Prior): 전체 데이터 중 번째 그룹이 차지하는 비중(가중치)인 혼합 계수

•

우도(Likelihood): 번째 가우시안 분포에서의 해당 데이터 이 나올 확률밀도함수 값

•

증거(Evidence): 모든 그룹( 부터 까지)에 대한 분자()를 더한 전체 합(분자를 0~1 사이의 확률 값으로 정규화)

E-Step의 결과로서 각각의 데이터 은 “그룹 1일 확률 80%, 그룹 2일 확률 15%, 그룹 3일 확률 5%”와 같은 형태로 소프트 레이블(soft label)을 부여받게 된다.

E-Step의 주요 내용: 데이터에 대한 소프트 레이블링

M-Step: 모델 매개변수 최적화

M-Step은 E-Step에서 구한 확률(소프트 레이블)을 정답으로 삼고, 목적함수인 로그-우도 함수를 최대화하도록 가우시안 분포들의 매개변수()를 새롭게 계산하는 단계이다.

이때 중요한 것은 가중 평균(weighted average)을 사용하는 것이다.

•

예: 특정 그룹에 속할 확률이 0.9인 데이터는 0.1인 데이터보다 그 그룹의 새로운 평균 위치를 결정할 때 훨씬 큰 영향력(가중치)를 가짐

M-step의 주요 내용: 책임도를 기반으로 분포 매개변수 갱신

모든 데이터(개)에 대해 번째 분포의 책임도() 총합을 구하고, 이를 번째 분포에 할당된 유효 데이터 개수()로 정의한다. 모든 를 더하면 전체 데이터 개수 N이 된다. ()

번째 분포의 유효 데이터 개수 를 이용해 해당 분포의 새로운 평균(가중 평균)과 공분산을 계산한다.

마지막으로, 번째 분포의 유효 데이터 개수 를 전체 데이터 개수 으로 나누어 해당 분포가 차지하는 비중인 혼합 계수를 갱신한다.

새로 계산된 분포를 바탕으로 다시 E-step(레이블 재계산)을 수행하고, 또다시 M-step(분포 갱신)을 수행한다. EM 알고리즘은 이 과정을 반복하며 로그-우도 최대화를 유도하며, 매개변수가 더 이상 변하지 않을 때 종료한다.

EM 알고리즘의 한계점

EM 알고리즘은 잠재변수 도입과 젠센 부등식을 통한 하한(lower bound) 최대화라는 우회적인 방식 위에서 동작함으로써 GMM의 복잡한 수학적 최적화(로그 안의 덧셈 문제)를 해결한다.

EM 알고리즘을 사용할 때 유의할 점은 처음에 분포를 랜덤하게 초기화하기 때문에, 자칫 잘못하면 전역 최적해(global maxima)가 아니라 지역 최적해(local maxima)에 빠질 위험이 있다.

GMM의 대표적 응용: 데이터 분류

학습이 완료되어 최적화된 GMM의 매개변수 ()를 얻게 되면, 이를 데이터 분류기로 사용할 수 있다.

GMM은 새로운 입력 데이터 가 주어졌을 때, 각 가우시안 분포(class)에 속할 확률 를 계산하므로, 가장 높은 확률을 나타내는 를 찾는 연산을 통해 최종 Class 레이블을 예측하게 된다.

이 결과는 즉시 데이터의 그룹화에 적용될 수 있기 때문에, GMM은 대표적인 군집화(clustering) 알고리즘으로 많이 활용된다.

GMM의 대표적인 응용: 데이터 분류 및 군집화

퀴즈

퀴즈

문제 1: GMM 모델에서 으로 설정하였고, 라면, 의 값은?

정답

문제 2: 단일 정규분포와 달리, GMM에서는 수식을 한 번에 미분하여 매개변수를 찾을 수 없다. 수식의 어떤 특징 때문일까?

정답

문제 3: E-step에서 데이터에 레이블을 부여할 때, “이 데이터는 무조건 1번 그룹이야!” 라고 1이나 0으로 단정 짓지 않는다. 어떻게 레이블을 부여하는가?

정답

문제 4: EM 알고리즘의 M-step에서 특정 그룹의 새로운 평균()을 구할 때, 모든 데이터를 똑같이 취급하는가? 아니라면 어떻게 계산하는가?

정답

문제 5: EM 알고리즘이 지역 최적해(local maxima)에 빠져 잘못된 분포로 수렴하는 것을 방지하기 위해, 실무에서는 어떤 방법을 검토해볼 수 있을까?

정답

참고자료

•

◦

엄밀한 수학적 정의 및 전개

•

NotebookLM 요약 슬라이드

선수지식

.png&blockId=04a8d577-ace8-4bac-bec8-3da8a3f63bbd)